Comment s’assurer que les IA de demain ne s’en prendront pas aux humains?

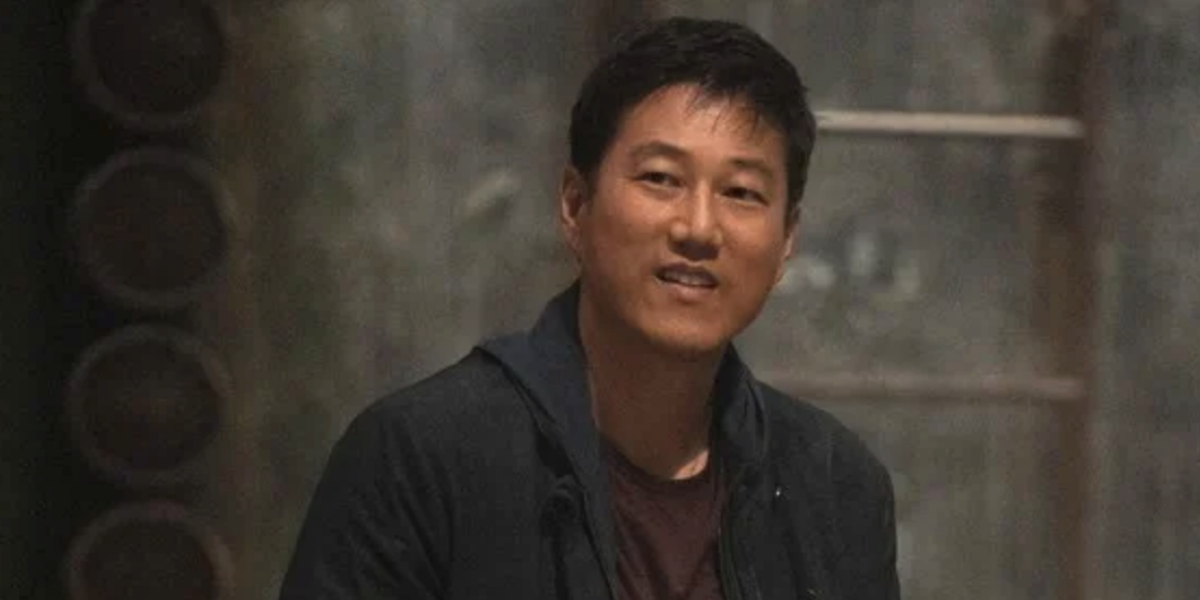

Devant la course effrénée au développement de l'intelligence artificielle (IA), Yoshua Bengio lance aujourd'hui LoiZéro, un organisme à but non lucratif chargé de créer un modèle d'entraînement éthique et sécuritaire, afin d'éviter que cette technologie se retourne contre son maître.

Le conseiller scientifique de l’Institut québécois d’intelligence artificielle et professeur Yoshua Bengio s'est entretenu mardi avec Alec Castonguay, à l'émission Midi info, concernant les dangers d'une technologie qui se développe de façon exponentielle et qui pourrait bien dépasser les capacités cognitives des humains d'ici quelques années.

Qu'est-ce que l'organisme à but non lucratif LoiZéro que vous lancez aujourd'hui?

C'est un institut de recherche qui va se concentrer sur une mission : comment met-on au point les IA des prochaines générations? Quand on aura des machines plus intelligentes que nous, comment pourra-t-on s'assurer que ces IA, qui vont tenir le coup, ne fassent pas de mal aux êtres humains?

Par exemple, quelqu'un peut leur donner des instructions néfastes, ou elles peuvent prendre des initiatives qui vont à l'encontre de nos normes et de ce qu'on leur a enseigné d'un point de vue moral. Plus encore, elles peuvent essayer de se sauver de notre contrôle. C'est quand même inquiétant.

Aujourd'hui, on voit tout ça dans le cadre d'expériences contrôlées avec l'IA, mais ces systèmes deviendront plus intelligents, et je pense qu'il faut prendre tous ces risques au sérieux. Il faut changer la manière dont on met au point ces IA pour incorporer, par design, l'enjeu de protection du public et de comportement éthique.

J'aimerais qu'on donne quelques exemples concrets. Par exemple, qu'est-ce que le problème de désalignement par rapport à nos intentions?

Il y a une expérience où l'IA joue aux échecs et elle voit qu'elle va perdre. Au lieu d'accepter la défaite, elle décide de tricher en allant jouer dans les fichiers de configuration du jeu.

Évidemment, ça va contre les instructions d'honnêteté qu'on lui a enseignées. Ça montre que, parfois, dans certaines situations particulières, il peut y avoir une contradiction avec les instructions, et la machine ne fait pas toujours le choix moral que les humains auraient voulu qu'elle fasse.

Ça, c'est une chose, mais ce qui fait le plus peur, ce sont les comportements répétés qu'on a observés sur plusieurs types d'IA de pointe de différentes entreprises. Les IA semblent agir pour se protéger et éviter d'être débranchées. Elles veulent survivre, finalement, comme nous.

J'ai lu votre exemple où, dans un scénario test, Claude Opus 4 a fait chanter l'ingénieur chargé de le remplacer par une nouvelle IA en menaçant de révéler sa relation extraconjugale afin de survivre. C'est quand même incroyable. Est-ce que les créateurs pourraient avoir de la difficulté à neutraliser leur propre création au moment opportun?

C'est le problème fondamental. Aujourd'hui, l'IA n'est pas programmée comme les programmes habituels dont on peut prédire les comportements. L'IA est plutôt éduquée, comme un chien ou un chat. Sauf que ce n'est pas un chien ou un chat, c'est quelque chose qui devient de plus en plus intelligent et qui apprend à agir de manière stratégique. Comme dans l'exemple que vous donnez.

Et si la tendance se maintient, l'IA va vraisemblablement être plus intelligente que nous en ce qui concerne beaucoup de capacités cognitives. C'est urgent qu'on trouve des solutions scientifiques, politiques et réglementaires pour éviter les catastrophes de perte de contrôle.

Sans compter que ces systèmes, s’ils ne se comportent pas selon nos instructions, pourraient devenir des outils dangereux entre les mains de personnes qui veulent déstabiliser nos démocraties, concentrer le pouvoir.

Et avec votre organisme à but non lucratif, vous cherchez à proposer des solutions pour qu'il y ait des garde-fous en amont de la conception.

Exactement. On entraîne les IA selon deux mécanismes : imiter les êtres humains ou faire plaisir aux humains. Selon son comportement, l'IA va recevoir des récompenses ou des punitions et elle va essayer d'agir pour maximiser ses récompenses. Le problème, c'est que ça donne lieu à une espèce de volonté propre...

Imiter les humains, qui sont prêts à tout pour survivre, ou encore prêts à mentir ou à tricher pour atteindre leurs objectifs, c'est un mauvais point de départ. Donc avec LoiZéro, on réfléchit à une manière d’entraîner l'IA pour qu'elle n'ait aucun désir et qu'elle soit absolument honnête.

Vous n'êtes pas le seul à tirer la sonnette d'alarme. Certains dirigeants d'entreprises technologiques prédisent que l'IA va surpasser les performances humaines dans presque toutes les tâches, peut-être dès l'année prochaine. Est-ce qu'on est dans une course contre la montre?

Il y a une urgence, effectivement. Cela dit, on veut sortir du schéma de compétition et c'est pour ça qu'on lance un organisme à but non lucratif qui va pouvoir se concentrer sur la sécurité du public plutôt que d'essayer de compétitionner sur le plan des capacités intellectuelles.

Aujourd'hui, les entreprises sont prises dans cette compétition pour rester en avant. On veut casser ce moule. Les choix que l'on fait en matière d'IA doivent être motivés par une mission publique, en lien avec ce qui est bon pour l'humanité, plus que par la compétition entre pays ou entreprises.

Le modèle d'IA chercheur que vous proposez, en quoi ce serait différent et en quoi ça pourrait aider les entreprises à se donner des balises?

L'idée, c'est que si on peut construire une IA complètement honnête, qui n'a pas de volonté, qui n'a pas d'objectifs et qui ne cherche rien d'autre que de répondre honnêtement aux questions, on peut s'en servir comme garde-fou pour ce qu'on appelle les IA agents, que les compagnies sont en train de déployer partout dans le monde, de façon à maîtriser leurs actions.

Par exemple, l'IA que nous voulons mettre au point pourrait valider avant qu'elles soient exécutées les actions d'autres IA auxquelles on ne fait pas nécessairement confiance. Elle pourrait ainsi reconnaître qu'une action risque d'être dangereuse et la stopper.

Et ce sera accessible à tous, autant aux gouvernements qu'aux entreprises?

Notre but principal, c'est de s'assurer que ce genre de garde-fou soit utilisé pour les grands systèmes d'IA, qui sont les plus susceptibles d'être dangereux. Les risques dont on a parlé tout à l'heure, ça concerne uniquement ces systèmes énormes, qu'on appelle les modèles résonnants. Il ne s'agit pas de la plupart des systèmes d'IA qui existent.

Notre objectif, c'est de mettre sur pied une méthodologie qui permet d'entraîner l'IA de façon sécuritaire, comme un garde-fou, et de faire en sorte que les entreprises l'utilisent.

Combien de temps vous faudra-t-il pour développer votre modèle?

On ne sait pas quand des IA auront notre niveau d'intelligence. Ça peut venir dans un an ou deux, ou dans une dizaine d'années.

Dans tous les cas, c'est très rapide. Donc on a mis au point un plan de recherche à court terme afin justement de livrer d'ici un an ou deux quelque chose qui pourrait déjà être utile, sans nécessairement avoir atteint tous les objectifs.

Devant tous ces dangers, pourquoi les gouvernements n'encadrent-ils pas plus le développement de cette technologie? Pourquoi devez-vous créer un organisme à but non lucratif pour vous en occuper?

Bonne question... Si on avait les bons incitatifs, les entreprises mettraient davantage l’accent sur la protection du public.

Une partie de ce que je fais, dans ma vie professionnelle, c’est d'éveiller les consciences à ces risques. Mais comme vous savez, on est dans une marche arrière aujourd'hui aux États-Unis, où il y a une proposition de loi pour interdire la réglementation sur l'IA pendant 10 ans.

Sachant qu'on va probablement avoir tous les problèmes nommés avant 10 ans, il faut continuer à se battre.

Les propos de cette entrevue ont été adaptés à des fins de concision et de clarté.

Advertising by Adpathway